Рассмотрим источник сообщений с алфавитом знаков {G, U, L, F}. Вероятности знаков в текстах этого источника выберите самостоятельно. Считая появления знаков независимыми, найдите энтропию источника.

«Рассмотрим источник сообщений с алфавитом знаков {G, U, L, F}. Вероятности знаков в текстах этого источника выберите самостоятельно. Считая появления знаков независимыми, найдите энтропию источника.»

- Теория вероятностей

Условие:

Рассмотрим источник сообщений с алфавитом знаков {G, U, L, F}. Вероятности знаков в текстах этого источника выберите самостоятельно.

Считая появления знаков независимыми, найдите энтропию источника. Какое количество информации мы получим, узнав о появлении какого-то знака на выходе, - конкретного знака? Какой будет энтропия источника, если его состояния отождествлять со всевозможными парами знаков? Сколько информации содержится в сообщении о том, что в паре нет гласных, две гласные, одна гласная? Сколько информации содержится в сообщении из пяти знаков? Найдите собственную информацию сообщения LFFULG.

Решение:

1. Пусть

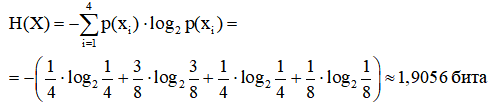

Энтропия источника:

Количество информации при появлении на выходе конкретного знака:

Похожие задачи

Не нашел нужную задачу?

Воспользуйся поиском

AI помощники

Выбери предмет

S

А

Б

В

Г

И

К

М

П

- Правоохранительные органы

- Пожарная безопасность

- Парикмахерское искусство

- Природообустройство и водопользование

- Почвоведение

- Приборостроение и оптотехника

- Промышленный маркетинг и менеджмент

- Производственный маркетинг и менеджмент

- Процессы и аппараты

- Программирование

- Право и юриспруденция

- Психология

- Политология

- Педагогика

Р

С

Т

- Трудовое право

- Теория государства и права (ТГП)

- Таможенное право

- Теория игр

- Текстильная промышленность

- Теория вероятностей

- Теоретическая механика

- Теория управления

- Технология продовольственных продуктов и товаров

- Технологические машины и оборудование

- Теплоэнергетика и теплотехника

- Туризм

- Товароведение

- Таможенное дело

- Торговое дело

- Теория машин и механизмов

- Транспортные средства

Ф

Э